Do Desvio Padrão ao Kolmogorov-Smirnov: Técnicas para Análise de Telemetria

Recentemente, ao ler o livro "Manual de DevOps", me deparei com um capítulo dedicado à telemetria em DevOps que expandiu significativamente minha compreensão sobre o tema. O autor apresenta a telemetria como um pilar fundamental da computação moderna, e seus argumentos são convincentes.

A telemetria tornou-se essencial para garantir a confiabilidade e a performance dos sistemas atuais. É por meio dela que conseguimos verificar se nossas pipelines de CI/CD estão executando conforme esperado, se nossas aplicações mantêm os níveis de performance adequados e, crucialmente, quando algo dá errado, é através dos dados telemétricos que identificamos rapidamente os componentes responsáveis pelo problema.

Além do aspecto operacional, a telemetria possui um valor estratégico muitas vezes subestimado: ela permite quantificar métricas em nível empresarial, transformando dados técnicos em insights de negócio. Mais que isso, com as técnicas adequadas de análise estatística, podemos detectar anomalias de forma proativa, antecipando problemas antes que impactem usuários ou processos críticos.

Níveis de Registro

Para suportar vários modelos de uso, com dados de diferentes lugares, temos diferentes níveis de registro, dos quais alguns podem disparar alertas e outros não há necessidade:

Nível DEPURAÇÃO: Neste nível, as informações são tudo o que acontece no programa, mas frequentemente usadas durante a depuração. Frequentemente os registros da depuração são desabilitados na produção ou habilitados temporariamente durante a solução de problemas.

Nível INFORMAÇÃO: As informações deste nível consistem em ações tomadas pelo usuário ou específicas do sistema (por exemplo, "iniciar transação de cartão de crédito").

Nível AVISO: As informações neste nível relatam condições que podem se tornar um erro (por exemplo, uma chamada de banco de dados demorando mais do que um tempo predefinido). Elas provavelmente iniciarão um alerta e uma solução de problemas, enquanto outras mensagens de registro podem nos ajudar a entender melhor o que levou a essa condição.

Nível ERRO: As informações neste nível focam em condições de erro (por exemplo, falhas de chamada de API, condições de erro interno).

Nível FATAL: As informações neste nível relatam quando devemos encerrar (por exemplo, um daemon de rede não consegue vincular um soquete de rede).

Lacunas que a Telemetria pode detectar e ajudar a resolver

Nível empresarial: Exemplos incluem o número de transações de vendas, lucro de transações de vendas, inscrições de usuário, taxa de rotatividade, resultados de testes A/B etc.

Nível de aplicativo: Exemplos incluem tempos de transação, tempos de resposta de usuário, falhas de aplicativo etc.

Nível de infraestrutura (por exemplo, banco de dados, sistema operacional, rede, armazenamento): Exemplos incluem tráfego de servidor web, carga de CPU, utilização de disco etc.

Nível de software cliente (por exemplo, JavaScript no navegador cliente, aplicativo móvel): Exemplos incluem erros e falhas de aplicativo, tempos de transação medidos pelo usuário etc.

Nível de pipeline de implementação: Exemplos incluem status do pipeline de build (por exemplo, vermelho ou verde para nossos vários conjuntos de testes automatizados), tempos de execução de implantação, mudança, frequências de implementação, promoções de ambiente de teste e status de ambiente.

O livro destaca problemas comuns que surgem quando os dados não seguem uma distribuição gaussiana (normal). Embora o uso de médias e desvio padrão seja extremamente útil em muitos casos, essas técnicas nem sempre geram os resultados desejados para diversos conjuntos de dados. Por exemplo, você pode enfrentar um cenário em que alertas são constantemente disparados ao usar a regra dos 3 desvios padrão, gerando muitos falsos positivos.

Entendendo o Desvio Padrão: O desvio padrão é uma medida estatística que indica o quanto os valores de um conjunto de dados se dispersam em relação à média. Em uma distribuição normal, aproximadamente 68% dos dados estão dentro de 1 desvio padrão da média, 95% dentro de 2 desvios padrão, e 99,7% dentro de 3 desvios padrão. No contexto de monitoramento, a regra dos 3 desvios padrão é frequentemente usada para identificar anomalias: valores que ultrapassam 3 desvios padrão da média são considerados outliers. No entanto, quando os dados não seguem uma distribuição normal, essa abordagem pode gerar alertas excessivos e imprecisos. Ferramentas que possuem essa técnica: Praticamente todas as ferramentas de monitoramento modernas suportam cálculo de desvio padrão.

Agora que sabemos quais dados são relevantes para o nosso ambiente e como classificá-los em caso de falhas, o livro apresenta uma visão crucial sobre identificação de problemas que realmente expandiu minha mente. O monitoramento eficaz não se resume apenas a gerar alertas, um dos maiores desafios que muitas empresas enfrentam hoje é o volume excessivo de incidentes abertos que, na realidade, não representam problemas reais. Essa "fadiga de alertas" acaba fazendo com que a equipe de operações descarte ou ignore notificações, incluindo aquelas que sinalizam problemas genuínos.

O monitoramento inteligente vai além de simplesmente disparar um alerta quando a CPU ultrapassa 90%. Trata-se de identificar anomalias ou padrões de uso de recursos que historicamente não ocorriam. Por exemplo, um banco de dados que normalmente recebe 100 acessos por minuto e subitamente cai para 80 acessos pode indicar um problema, mesmo que esse valor não ultrapasse nenhum limite pré-estabelecido. O livro explora como a estatística pode nos aproximar dessa identificação de problemas reais.

Técnica de Suavização (Smoothing): Uma das técnicas apresentadas é a "suavização", que envolve o uso de médias móveis para transformar dados ruidosos em tendências mais claras. A suavização calcula a média de cada ponto em relação a todos os outros dados dentro de uma janela de tempo específica. Isso reduz flutuações de curto prazo e destaca padrões de longo prazo. Por exemplo, em vez de analisar valores individuais de CPU a cada segundo (que podem variar drasticamente), você calcula a média dos últimos 5 ou 10 minutos, obtendo uma visão mais estável do comportamento do sistema. Essa técnica é especialmente útil para eliminar "ruído" nos dados e facilitar a identificação de tendências reais. Ferramentas que possuem essa técnica: Grafana, Prometheus, Datadog, Graphite, NewRelic, Dynatrace, InfluxDB, Elasticsearch/Kibana.

Teste de Kolmogorov-Smirnov: Outro método abordado, utilizado em ferramentas como Grafana e Graphite, é o teste de Kolmogorov-Smirnov (K-S). Esse é um teste estatístico não-paramétrico usado para comparar duas distribuições de dados e determinar se elas são significativamente diferentes. No contexto de monitoramento, o teste K-S é particularmente útil para analisar métricas periódicas ou sazonais. Por exemplo, você pode comparar o padrão de tráfego web de hoje com o padrão de tráfego de terças-feiras anteriores. Se o teste K-S indicar uma diferença estatisticamente significativa entre as distribuições, isso pode sinalizar uma anomalia que merece investigação. Essa abordagem é mais sofisticada do que simplesmente comparar médias, pois considera a forma completa da distribuição dos dados. Ferramentas que possuem essa técnica: Grafana, Graphite, NewRelic, Dynatrace, Datadog.

O livro também apresenta diversos casos de uso dessas ferramentas em diferentes empresas e cenários reais, demonstrando sua aplicabilidade prática.

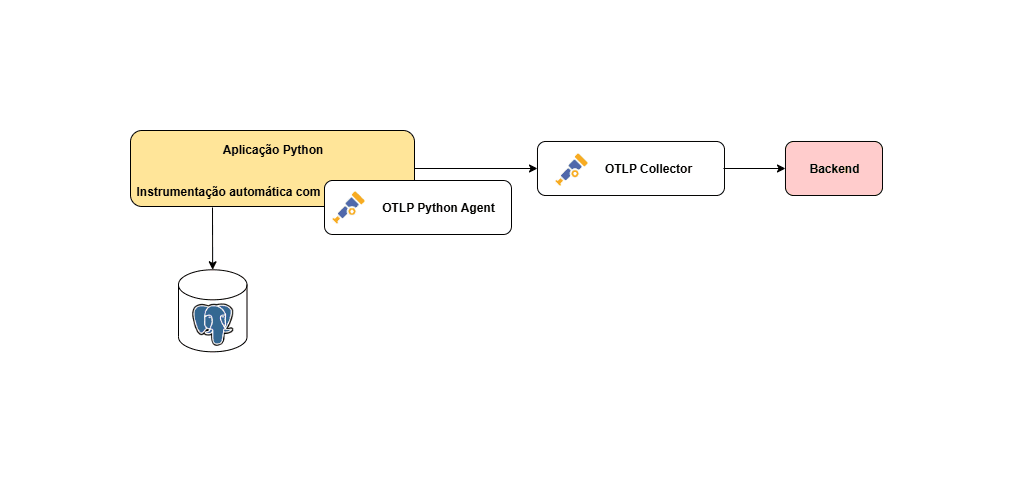

Uma ideia interessante proposta é a implementação de uma arquitetura de monitoramento inteligente: você pode usar ferramentas tradicionais como Zabbix, Prometheus ou outras para coleta de métricas. Esses dados são então enviados para uma aplicação desenvolvida em Python ou R, que realiza processamento estatístico avançado. Através dessa análise estatística, a aplicação verifica se existe uma anomalia real antes de disparar um alerta. Essa abordagem híbrida combina a robustez das ferramentas de monitoramento estabelecidas com a flexibilidade e o poder da análise estatística, resultando em alertas mais precisos e significativos, reduzindo a fadiga de alertas e melhorando a eficiência operacional.

Recomendações por Cenário

Implementação Básica:

Prometheus + Grafana

Desvio padrão: ✅ Nativo

Suavização: ✅ Nativo

K-S: ⚠️ Requer integração

Análise Estatística Avançada:

Prometheus/Zabbix (coleta) → Python/R (análise) → Grafana (visualização)

Todas as três técnicas: ✅ Totalmente suportadas

Controle completo sobre algoritmos

Flexibilidade máxima

Solução Enterprise com IA/ML:

Dynatrace ou Datadog

Desvio padrão: ✅ Automático

Suavização: ✅ Automática

K-S ou similar: ✅ Algoritmos proprietários de ML

Para Stack ELK:

Elasticsearch + Kibana + Machine Learning

Todas as técnicas através de agregações e ML

Ótimo para logs e métricas combinados